Von der Fehler- zur Irrtumskultur?

Oder: Warum wir mehr über Irrtümer sprechen sollten

Bei der Vorbereitung meines Skripts für unseren diesjährigen „Zertifikatslehrgang Transformations- und Turnaround-Manager“ in Heidelberg (Zertifikatslehrgang Transformations- & Turnaround-Manager| ifus-institut.de) bin ich auf einen bis dahin nicht bewusst wahrgenommenen und spannenden Unterschied gestoßen: dem zwischen Fehler und Irrtum. Die Befassung damit war für mich so erhellend, dass ich mich entschlossen habe, diesen Unterschied zu verinnerlichen und in diesem Beitrag mit anderen zu teilen.

Beeindruckt hat mich dabei insbesondere der mögliche Zusammenhang von Fehlern und Irrtümern mit geordneten und ungeordneten Systemen. Doch der Reihe nach.

Zu Beginn vielleicht eine Begriffsklärung. Unter einem Fehler verstehe ich in Anlehnung an das „Digitale Wörterbuch der deutschen Sprache“ eine „unbeabsichtigte Abweichung vom Richtigen“. Dabei gehe ich bewusst nicht von einem Ziel aus, sondern von etwas bereits Bekanntem, etwas als richtig und erwünscht Angenommenem. Mit anderen Worten: Jemand verfügt grundsätzlich über das Wissen, wie etwas sicher richtig funktioniert, wendet dieses Wissen aber aus irgendeinem Grund falsch an, was zu einem Fehler respektive einer negativen Abweichung vom Richtigen führt.

Unter einem Irrtum hingegen verstehe ich ein „falsches Urteil im Denken“. Mit anderen Worten: Es gibt noch keine ausgearbeitete Lösung, die mit Sicherheit das Richtige hervorbringt. Hier wird mit Annahmen gearbeitet, die auf einem Fehlurteil beruhen können und in diesem Fall nicht zum gewünschten Ergebnis führen.

Die etymologischen Erläuterungen erspare ich mir. Sie sind in diesem Zusammenhang nicht so wichtig, mir geht es weniger um Semantik als vielmehr um Prinzipien. Daher möchte ich hier bewusst auf eine Diskussion über Spitzfindigkeiten bei der Interpretation von Begriffen verzichten.

Wichtiger für die Diskussion scheint mir ein hilfreicher Ansatz zur Unterscheidung zwischen geordneten und ungeordneten Systemen, der von David J. Snowden stammt, einem führenden Forscher auf dem Gebiet des Wissensmanagements und der angewandten Komplexitätswissenschaft. Er nennt seinen Ansatz „Cynefin“, nach einem walisischen Wort für die vielen Faktoren in unserer Umwelt, die uns beeinflussen, ohne dass wir uns dessen immer bewusst sind. Dieser Ansatz, der bereits vor rund 15 Jahren im Harvard Business Manager vorgestellt wurde, bietet Managern eine gute Grundlage, um Entscheidungen zu treffen – abhängig vom Kontext, dem Erfahrungshorizont und dem Beziehungsgeflecht des Managers.

Im vergangenen Sommer war ich schon einmal ausführlicher auf diesen Ansatz eingegangen (Beitrag #11, „Radikal führen in radikalen Zeiten“). Zum besseren Verständnis seien hier erneut die zwei wesentlichen Grundsysteme zusammengefasst, die Snowden unterscheidet (auf das dritte und vierte System will ich hier nicht eingehen).

Erstens: geordnete Systeme (die jedoch von einfach bis kompliziert variieren können). Diese Systeme zeichnen sich bereits ex ante durch klare kausale Wenn-Dann-Beziehungen aus. Die Ergebnisse von Handlungen sind klar vorhersehbar. Sie erfordern entweder „best practices“ oder – im Falle komplexer Herausforderungen – explizites Erfahrungswissen von Experten. So kann selbst die Armbanduhr Aeternitas Mega von Franck Muller, die 36 Komplikationen und 1483 Einzelteile hat sowie mehr als 2,5 Millionen US-Dollar kostet, von einem Experten auseinandergenommen und wieder zusammengesetzt werden.

In diesen Systemen besteht die Herausforderung für das Management darin, Lösungsräume zu erkennen und Lösungen effektiv umzusetzen. Im Vordergrund steht das Vermeiden von Fehlern, Irrtümer spielen eher selten eine Rolle.

Zweitens: Ungeordnete oder komplexe Systeme. Diese stehen heute meist im Fokus. Hier können Manager nicht auf Best Practices oder bewährte Rezepte aus der Vergangenheit zurückgreifen. Hier lassen sich Wirkungszusammenhänge erst im Nachhinein erkennen, da sich die einzelnen Elemente gegenseitig bedingen und neue Entwicklungsmuster hervorbringen können. Der Schwarzwald zum Beispiel ist ein hochkomplexes System, das ständig in Bewegung ist und von so unterschiedlichen Variablen wie Wetter, Forstwirtschaft, Tieren etc. abhängt, dass das Ganze viel mehr ist als die Summe seiner Teile. Snowden schrieb 2007 über solche Systeme:

„This is the realm of ‘unknown unknowns’, and it is the domain to which much of contemporary business has shifted.”

Die „unknown unknowns“ – ein Begriff, der Jahre zuvor durch eine Bemerkung des damaligen US-Verteidigungsministers Donald Rumsfeld berühmt geworden war – sind Dinge, von denen wir nicht einmal wissen, dass wir sie nicht wissen (im Gegensatz zu den Dingen, die wir wissen, sowie den Dingen, von denen wir wissen, dass wir sie nicht wissen). In der Wirtschaft bedeutet diese Unsicherheit zweiter Ordnung, dass die Führung in einen explorativen Modus wechseln und ständig lernen muss, wie sich das System verändert. Sie befindet sich dann in einem iterativen Lernprozess, der ein ständiges und konsequentes Nachjustieren des eigenen Handelns erfordert. Dabei können so genannte „Emergent Practices“ entstehen – neue Handlungsmuster, die sich als sinnvoll erweisen.

Auch in ungeordneten Systemen kommt es zu Fehlern, nur dass keine Missverständnisse aufkommen. Allerdings sollte ihre Vermeidung hier eher zum Standard gehören, denn diese Systeme sind in all ihrer Komplexität und Unsicherheit deutlich anfälliger für Irrtümer. Daher sollte der Fokus des Managements auf diesen liegen – respektive auf der Frage, wie Unternehmen am besten mit Irrtümern umgehen sollten.

Um etwas verständlicher zu machen, worum es mir geht, greife ich zur Veranschaulichung ein Transformationsprogramm aus unserer Beratungswelt auf, wie wir es in der täglichen Praxis in verschiedenen Facetten entwickeln und umsetzen.

Ein solches Transformationsprogramm wird unter unsicheren Rahmenbedingungen – und damit in einem komplexen System – entwickelt. Der Kern eines solchen Programms ist ein integrierter Businessplan, der mit quantifizierten Maßnahmen unterlegt ist. Anhand des Businessplans lassen sich die Unterschiede zwischen Fehlern und Irrtümern relativ einfach operationalisieren. Bei der Entwicklung eines Plans können einem sowohl Fehler als auch Irrtümer unterlaufen. Ein solcher Plan besteht aus einem Planungsmodell und Variablen, die dieses Modell mit Leben füllen.

Fehler werden vor allem bei der Entwicklung des Planungsmodells und der Berechnungslogik gemacht. Denn hier gibt es feste, bekannte Wenn-Dann-Beziehungen. Diese Beziehungen sind fest verknüpft und führen zu einem klar prognostizierten Ergebnis. Beispiele lauten:

- Bei einem Verlust reduziert sich ohne weitere Maßnahmen das Eigenkapital.

- Erhöhen wir die Preise um 2 Prozent, ohne dass der Absatz sinkt, verbessert sich das Ergebnis um 2 Prozent.

Die Liste der bekannten Zusammenhänge ließe sich beliebig fortsetzen. Diese festen Beziehungen sind die Grundlage der Mathematik oder der Buchhaltung. Dennoch kommen auch in diesem System viele Fehler vor. Dabei hilft mir eine Einteilung in drei Kategorien:

Bewusste Fehler oder auch: Betrug. Jemand löscht bewusst etwas im Planungsmodell, um ein gewünschtes Ergebnis zu erzielen oder erfindet „mal eben“ Treuhandkonten auf den Philippinen, um den Finanzierungsbedarf zu verschleiern.

Versehentliche Fehler entstehen durch Unachtsamkeit, zum Beispiel indem eine Formel beim Kopieren überschrieben oder ein Komma falsch gesetzt wird. Es können auch entscheidende Variablen bei der Berechnung von Maßnahmen vergessen werden, was dazu führt, dass der Payback gar nicht realisiert wird. Solche Fehler lassen sich am besten durch Checklisten, Doppelkontrollen oder das Vier-Augen-Prinzip beheben.

Durch Inkompetenz bedingte Fehler sind auf die Unkenntnis einzelner Personen zurückzuführen. Dies ist jedoch kein Problem des Unbekannten, sondern des Unwissens. Es gibt Personen, die IFRS wirklich beherrschen und im Gegensatz zu einem klassischen HGB-Experten keine Fehler machen.

Diese Fehler sollten aus meiner Sicht nicht gefeiert werden. Wozu auch?

Vielmehr muss sichergestellt sein, dass Fehler sofort offengelegt werden, ohne Angst vor Repressalien und harten Sanktionen. Andernfalls ist es gar nicht möglich, Strategien zu entwickeln, um die Wiederholung von Fehlern zu vermeiden und es in Zukunft besser zu machen. Im Toyota-System gibt es das faszinierende Prinzip „Stop the Line“, bei dem das Band in der Produktion bewusst angehalten wird, um einen Fehler systemisch zu beseitigen. So werden die Menschen sogar ermutigt, den Prozess zu unterbrechen, um Qualität zu produzieren und das Ausufern von Problemen zu verhindern.

Während es bei einem mechanistischen Planungsmodell eine feste Kausalität zwischen den Variablen gibt, ist die Lage bei den Planungsannahmen viel komplexer. Für jede Annahme trifft das Management eine Entscheidung, die auf einer Prognose basiert, und die heutige Welt ist so komplex und so voller Unwägbarkeiten, dass solche Prognosen und Entscheidungen eine große Herausforderung darstellen. In den meisten Fällen verlangen solche Situationen neue Lösungsmuster. Diese Lösungsmuster müssen vom Management unter hoher Unsicherheit und enormer Komplexität entwickelt werden, und zwar nicht in einem entspannten Workshop, sondern im laufenden Betrieb, hier und jetzt. Dietrich Dörner, einer der führenden deutschen Forscher auf dem Gebiet der kognitiven Psychologie, beschreibt diese Art von Herausforderung wie folgt:

„Komplexe Entscheidungssituationen gleichen einem Schachspiel, bei dem ein Großteil der Figuren im Nebel liegt.“

Bei multikausalen Problemen mit vielen Überraschungen helfen einfach Rezepte wenig – dafür sind die Probleme zu vielschichtig und zu ernst. Und so können gerade hier viele Irrtümer gemacht werden. Bei ihrer Klassifizierung gehe ich von folgenden Kategorien aus:

Komplexitätsinduzierte Irrtümer sind auf Wirkungszusammenhänge zurückzuführen, die ex ante unklar waren und nur ex post festgestellt werden können. Welche Wirkungsmechanismen bei den Bestandskunden treten auf, wenn das Unternehmen ein neues Produkt in einem günstigeren Preissegment einführt? Eine solche Frage lässt sich zwar simulieren, aber nicht mit Sicherheit prognostizieren. Oder es werden plötzlich neue Absatzmärkte erschlossen, bei denen sich jeder im Nachhinein fragt, warum sie nicht früher erkannt wurden.

Unsicherheitsinduzierte Irrtümer waren in den letzten drei Jahren besonders ausgeprägt. Kommt ein Lockdown? Wie reagieren die Leute auf 2G? Wann kommt ein Impfstoff? Und immer so weiter. Das breite Spektrum an Möglichkeiten macht die Planung zu einem Glücksspiel. Uns hat hier das Denken in Szenarien sehr geholfen, um die Bandbreiten der Unsicherheit zu bestimmen und mögliche Handlungsoptionen besser zu definieren.

Hypothesengetriebene Irrtümer sind ein notwendiger Bestandteil der Unternehmensentwicklung und der strategischen wie operativen Perspektiven. Wir müssen unter Unsicherheit mit Hypothesen arbeiten, um daraus zu lernen, neue Muster zu erkennen und auch effektiv zu handeln. Hier spielt die Intuition eine besondere Rolle. Sie hilft, sich auf das Wesentliche zu konzentrieren und durch implizites Wissen die bestmöglichen Entscheidungen zu treffen. Bei sehr vielen Überraschungen kann vor allem die Intuition sehr hilfreich sein, um neue Wege auch ohne rationale Begründung zu finden. Der führende Risikoforscher und Psychologe Professor Dr. Gerd Gigerenzer (https://www.struktur-management-partner.com/insights/leadertalks#c4106) sagt:

„Intuition ist eine unbewusste Form der Intelligenz.“

Bei Hypothesen darf nicht vergessen, dass diese zur Validierung aufgestellt werden und dementsprechend auch konsequent verworfen werden müssen. Von meinem Geschäftsführerkollegen Marc-René Faerber habe ich schon vor 20 Jahren den sehr wahren Spruch übernommen:

„Inkonsequenz rächt sich immer – in der Krise besonders schnell.“

Explorative Irrtümer sind die klassischen Bausteine eines Innovationsprozesses, wo man neues Wissen gewinnt oder neue Ideen testet. Schon der berühmte Erfinder Thomas A. Edison brachte es auf den Punkt:

„Ich habe nicht versagt. Ich habe nur 10.000 Wege gefunden, die nicht funktionieren.“

Was folgt daraus für unseren Businessplan? Es ist brandgefährlich, sich auf Fünf-Jahres-Pläne zu versteifen und stur den einmal eingeschlagenen Weg zu verfolgen. In einer komplexen, dynamischen und auch unsicheren Welt ist besonders das von Professor Franz Röösli erwähnte adaptive Management hilfreich (https://www.struktur-management-partner.com/insights/leadertalks#c7046).

Im Umgang mit Irrtümern ist es schwierig, zwischen Anpassung und Konsequenz im Handeln zu unterscheiden. Wann ist der richtige Zeitpunkt, um die Reißleine zu ziehen? Tut man es zu früh, war man zu voreilig. Tut man es zu spät, war man zu inkonsequent. Zwischen beidem die Balance zu halten, ist die hohe Kunst des Managements.

Nur eines darf nie geschehen: dass man anfängt, Luftschlösser zu bauen, weil man sich vor unangenehmen Entscheidungen drückt, um das eigene Harmoniebedürfnis zu befriedigen. Es gilt eine alte Weisheit:

„Hoffnung ist kein guter Businessplan.“

Sicher ist: Irrtümer sind ein produktiver und kreativer Bestandteil erfolgreichen Unternehmertums. Sie lassen sich nicht vermeiden, wenn man handelt und erfolgreich sein oder bleiben will.

Nur ist es erstens wichtig, vorn vornherein klar zwischen Fehlern und Irrtümern zu unterscheiden. Diese Unterscheidung ist für die Lösungsfindung essenziell!

Zweitens sollten Unternehmen und Manager verstärkt den Fokus auf die Irrtümer richten. Gerne ist von einer „Fehlerkultur“ die Rede, die zu pflegen sei, im Sinne eines konstruktiven Zulassens und Daraus-Lernens. Daran ist per se nichts auszusetzen. Allerdings scheint es mir noch wichtiger, im Unternehmen für eine positive „Irrtumskultur“ zu sorgen, durch richtige Strukturen und viel gegenseitiges Vertrauen!

Wer in der komplexen, unsicheren, sich rasant wandelnden Welt von heute über solch eine „Irrtumskultur“ verfügt, dürfte im Wettbewerb klar im Vorteil sein.

Weitere Inhalte

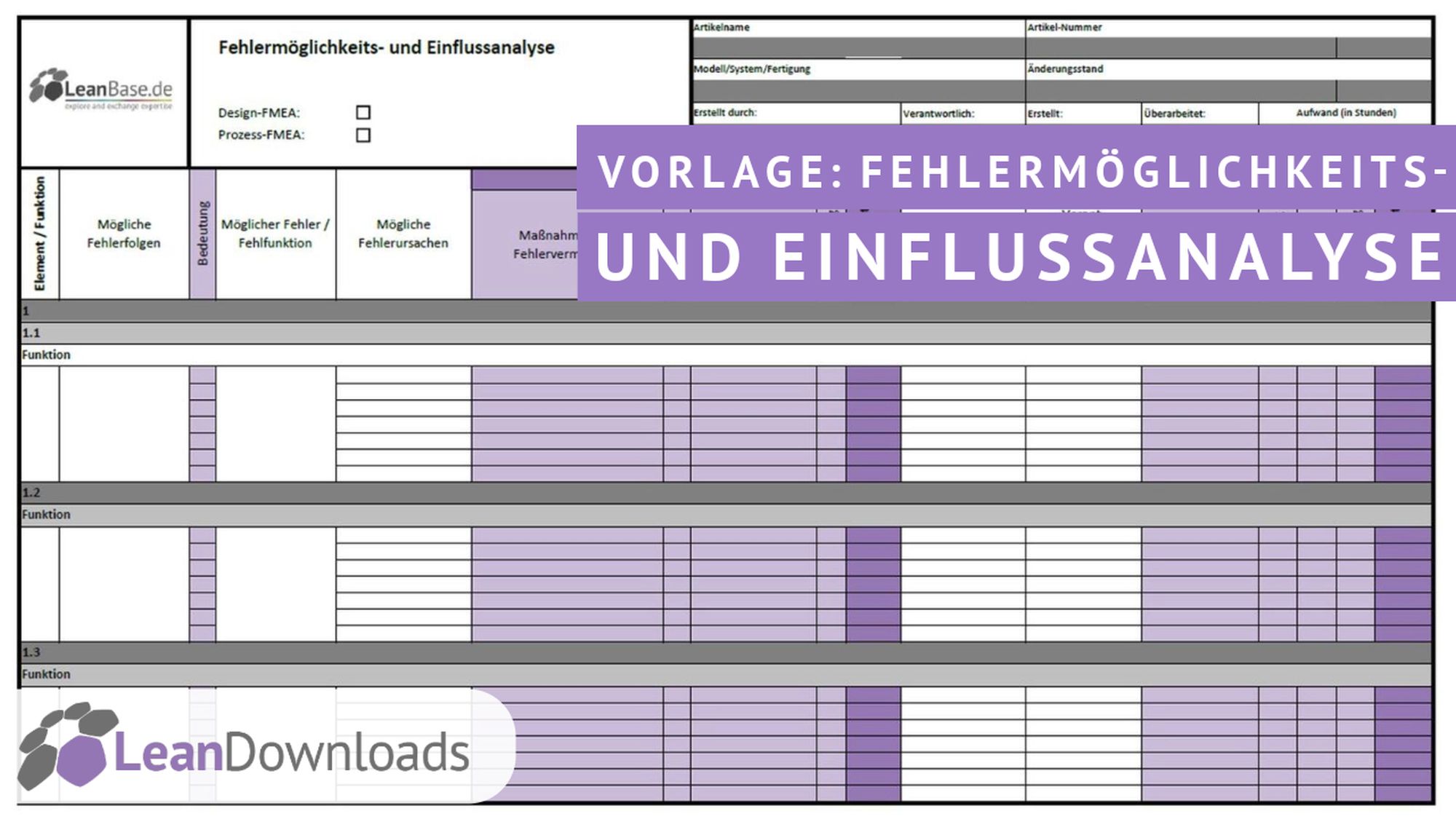

Kennst Du schon LeanDownloads?

-

Kostenfreie und kostenpflichtige Downloads zu Lean, Agile, Leadership und vielem mehr

-

Lade Dir z.B. Checklisten, Formulare, eBooks und Präsentationen herunter

-

Stelle selbst Deine kostenpflichtigen und kostenfreien Download-Angebote ein

Fehlermöglichkeits- und Einflussanalyse

Die Fehlermöglichkeits- und Einflussanalyse, auch als FMEA bekannt, ist eine systematische Methode zur Identifizierung und Bewertung potenzieller Fehler in einem Prozess, System oder Produkt. …

Management und Leadership - What's LEAN got to do with it?

Gibt es einen erfolgreichen Lean-Führungsstil? Und was zeichnet diesen aus?

Weitere Inhalte auf LeanPublishing

Das Fehlermodell nach Reason: Eine Analyse der Sicherheit in komplexen Systemen

Das Fehlermodell nach James Reason, auch bekannt als das Swiss Cheese Model, ist zu einem grundlegenden Konzept in der Fehlerforschung geworden. Es bietet einen Rahmen für die Analyse von …

Was wurde eigentlich aus der Verbesserungs- und CoachingKATA?

Vor gut und gerne 10 Jahren erschien „Die KATA des Weltmarktführers: Toyotas Erfolgsmethoden“ von Mike Rother. Darauf folgten, wie immer, wenn eine „neue Sau durch ein Dorf getrieben wird“, …

Industrie 4.0 meets Lean Management – ein Reisebericht: Our Way to Industry 4.0

Eine schnelle Angebots- und Auftragsbearbeitung, hohe Lieferbereitschaft und Termintreue sowie kurze Lieferzeiten und individualisierbare Produkte sind wesentliche Erfolgsfaktoren, mit denen es …

So geht Management heute

In den ersten Wochen kamen die Mitarbeiter mit diesem Verhalten überhaupt nicht klar. „Warum zeigt sich der Chef kaum noch in der Produktion? Warum bleibt sein Parkplatz vor der Verwaltung oft …

Kommentare

Fehler (und auch Irrtümer) werden immer sofort mit Menschen assoziiert - und somit ist man auch immer sofort beim WER hat es verbockt.

In diesem Unternehmen haben wir nun "Fehlerkultur" durch "Umgang mit Defekten" ersetzt. So konzentriert man sich auf das

WAS ist passiert

WARUM ist es passiert

WELCHE Maßnahmen müssen wir treffen, um Defekte in Zukunft zu vermeiden.

Fehler, also Abweichungen vom Soll werden nun "Defekte" genannt.

Fehlende, unvollständige, nicht richtig spezifizierte, oder falsche Definitionen in Prozessen sind "Singularitäten".

Das hat die "Fehlerkultur" binnen kurzer Zeit auf eine sachliche Ebene gebracht, die sehr viel emotionsfreier bearbeitet wird, als vorher.

Kommentar schreiben

Melde Dich an, um einen Kommentar zu hinterlassen.

Teilen